Forschungsprojekte (Auswahl)

HandsOn App and Virtual Touch Toolkit

HandsOn App Webseite (Deutsch)

The Virtual Touch Toolkit is a mobile based application promoting self-discovery by engaging social affective touch.

The COVID-19 pandemic has imposed many daunting challenges on us, but also has provided many opportunities for the invention of creative solutions and innovation. Mandatory solitude and perceived loneliness were some of the many challenges, which, albeit intolerable for some, provided space and time for focusing on personal facets of life by practicing self-awareness and introspection. The smartphone application, “Virtual Touch Toolkit” is an educational tool that promotes self-discovery by focussing on social affective touch. Features of the application aim to the popularise scientific knowledge regarding affective touch.

Social, affective, touch is the emotionally driven and intentional physical contact between us and is one of our most unrecognised needs. Recent research has revealed that affective touch is essential for the healthy development of infants right through to the emotional regulation of adult. This project looks at virtual touch. The “Virtual Touch Toolkit” neither conflicts with established social distancing rules nor encourages any transgression against attempts to impede the pandemic. The single-user interaction required via the application toolkit is limited to user interface elements and 3D models. The toolkit is primarily self-oriented, with a focus on activation of the affective touch system through either self-touch, vicarious touch, or imagined touch.

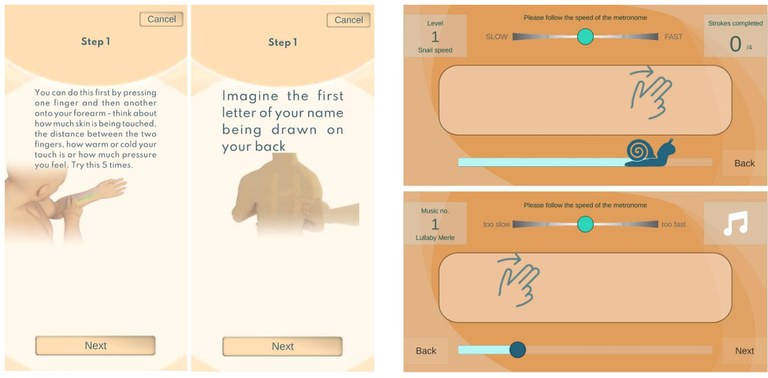

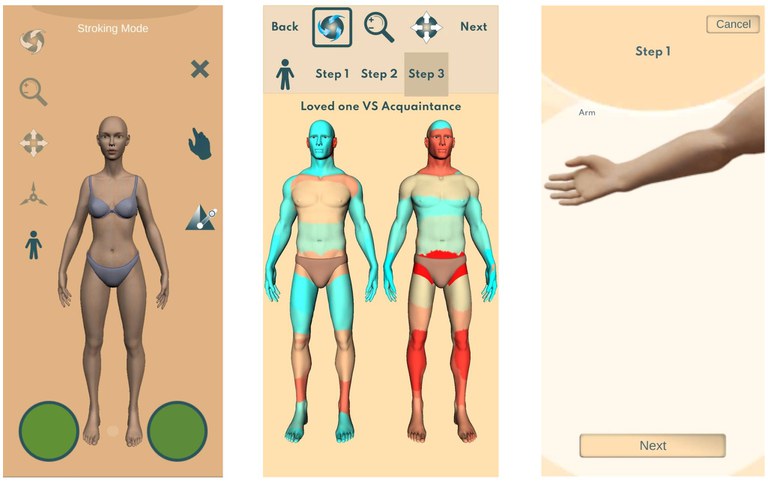

The first feature of the toolkit is called “Stroking”. The user is encouraged to interact with a human 3D model. The user simply strokes and imagines being stroked at the various body sites across the human model. The second feature of the toolkit is devoid of any social element and focuses on the discriminative aspect of touch - a form of metacognitive awareness training within the touch modality. The “Materials” option provides the user with an array of materials (e.g. wood) and encourages the user to focus on their emotions when touching a specific material. The final feature, called “Lullaby”, instructs the user to synchronize to the rhythm of a lullaby and practice affective touch with the assistance of the interface and a metronome.

The “Virtual Touch Toolkit” serves as a reminder of the importance of affective touch, as a basic human need. We live in an era where the concept of social touch is already increasingly deprecated, and the outbreak of the pandemic exacerbates this situation by pushing the perception of social touch to the point of demonization. We hope that the resolution of the COVID-19 pandemic will leave people as open-minded as possible regarding social touch.

This project is a co-operation of: Institute for Psychology, Bundeswehr University Munich, Munich, Germany; Faculty of Philosophy & Philosophy of Science & Munich Center for Neuroscience, Ludwig Maximilian University, Munich, Germany; Research Centre on Interactive Media Smart Systems and Emerging Technologies – RISE Ltd, Nicosia, Cyprus; GET Lab, Department of Multimedia and Graphic Arts, Cyprus University of Technology, Limassol, Cyprus; Liverpool John Moores University, School of Natural Sciences and Psychology, Liverpool, UK; University of Liverpool, Institute of Psychology Health & Society, Liverpool, UK; Event Lab, Department of Clinical Psychology and Psychobiology, Faculty of Psychology, Barcelona, Spain.

Forschungsinteressen

Sensomotorische Koordination

Ob Streichquartett, eine Gruppe von Basketballspielern oder ein Operationsteam, oft müssen wir uns zeitlich mit anderen abstimmen. Dieses Projekt erforscht die Faktoren, "mit wem" wir interagieren und "wie" wir mit ihnen interagieren, um eine erfolgreiche Koordination besser zu verstehen.

Koordination durch Berührung

Wir halten uns an den Händen, klopfen uns gegenseitig auf den Rücken und streicheln uns gegenseitig, um uns zu versorgen und zu kommunizieren. Dieses Projekt erforscht die kognitiven Mechanismen, durch die die so genannte affektive Berührung diese Signale überträgt.

Multisensorische Integration und Metakognition

Wir erleben die Welt mit all unseren Sinnen. Bei diesen multisensorischen Erlebnissen, wie dem Riechen und Schmecken eines Apfelstrudels, müssen Sinnesinformationen kombiniert (integriert) und auch reflektiert werden, wie z.B. die Frage: "Bin ich sicher, dass ich den Zimt wirklich schmecke?" (Metakognition), damit wir unserer Welt einen Sinn geben können. In diesem Projekt untersuchen wir die kognitiven und neuronalen Mechanismen, die dies ermöglichen, und wie einige sensorische Informationen anders gehandhabt werden können.

Sonifikation und Erweiterte Realität

Sensorische Informationen können über mehrere Sinne aus der Welt extrahiert werden, aber wir sind normalerweise auf das Sehen angewiesen. Die Forschung im Bereich der sensorischen Substitution und der erweiterten Realität hat jedoch gezeigt, dass wir unsere Erfahrungen abstimmen können, indem wir Informationen über unsere anderen Sinne extrahieren. In diesem Projekt erforschen wir Wege, die Realität zu erweitern, indem wir Informationen über den Hörkanal einstimmen - durch die Vertonung von Informationen in Musik oder informative Klänge, die uns besser in die Lage versetzen, einen gegebenen Kontext zu verstehen.

Bilder: Pixabay, Roman Kraft/Unsplash, Moose Photos/Pexels, Pixabay